IA

Qué es OpenClaw: El agente de IA Open-Source del momento

Si has pasado algo de tiempo en Twitter, Hacker News o Reddit en los últimos dos meses, probablemente has visto el emoji de langosta. ¿Qué es OpenClaw? Es el ag

Actualizado 13 de abril de 2026

Qué es OpenClaw: El Agente de IA Open-Source del Momento

Si has pasado algo de tiempo en Twitter, Hacker News o Reddit en los últimos dos meses, probablemente has visto el emoji de langosta. ¿Qué es OpenClaw? Es el agente de IA personal open-source que rompió todos los records de crecimiento en GitHub, es de hecho el proyecto con mayor cantidad de estrellas en GitHub en la actualidad, superando incluso a React, una librería de JavaScript de código abierto, desarrollada por Meta (Facebook) ni más ni menos. Pero ¿Cómo un proyecto desarrollado por una persona en su tiempo libre es capaz de superar a una empresa millonaria como Meta? Entender qué es OpenClaw importa porque representa un cambio fundamental también en cómo interactuamos con la inteligencia artificial. Creado por Peter Steinberger, fundador de PSPDFKit, OpenClaw pasó de cero a más de 300,000 estrellas en GitHub en aproximadamente sesenta días. Ya seas un desarrollador o un usuario curioso, esta guía responde qué es OpenClaw y te explica todo lo que necesitas saber.

Qué es OpenClaw y Por Qué Importa

La respuesta más simple a qué es OpenClaw: es un agente de IA autónomo, gratuito y open-source, antes conocido como Clawdbot y Moltbot. A diferencia de un chatbot tradicional que espera tu mensaje y devuelve una respuesta de texto, OpenClaw puede planificar tareas de múltiples pasos, llamar herramientas externas, navegar por la web, gestionar archivos y recordar contexto entre conversaciones. Cuando la gente pregunta qué es OpenClaw, la distinción clave es que es un agente, no un chatbot. Hace cosas en vez de solo hablar sobre ellas.

El proyecto importa por varias razones. Primero, se ejecuta completamente en tu hardware. Tus conversaciones, documentos y memorias nunca salen de tu máquina a menos que elijas explícitamente un modelo en la nube. Segundo, es agnóstico de modelo. Puedes conectar Claude, GPT, Gemini, o cualquier modelo local servido a través de Ollama. Tercero, la comunidad es enorme. Con más de 300,000 estrellas, 50,000 forks y miles de contribuidores, OpenClaw ha construido el tipo de ecosistema que garantiza mantenimiento a largo plazo.

Si te preguntas cómo funciona por dentro el modelo que OpenClaw utiliza como motor, nuestra guía sobre cómo funciona un LLM te explica el fundamento en lenguaje claro. Sin ese contexto, muchas de las decisiones de diseño de OpenClaw parecerán arbitrarias.

Peter Steinberger anunció en febrero de 2026 que se uniría a OpenAI, y el proyecto sería transferido a una fundación open-source independiente. Una vez que entiendes qué es OpenClaw en su esencia, te das cuenta de que no es un experimento de fin de semana sino una pieza seria de infraestructura que ya utilizan miles de personas en todo el mundo.

Para empresas que quieren explorar cómo los servicios impulsados por IA pueden transformar sus flujos de trabajo, OpenClaw representa el tipo de herramienta que devuelve el control a tus manos.

Cómo Funciona OpenClaw Por Dentro

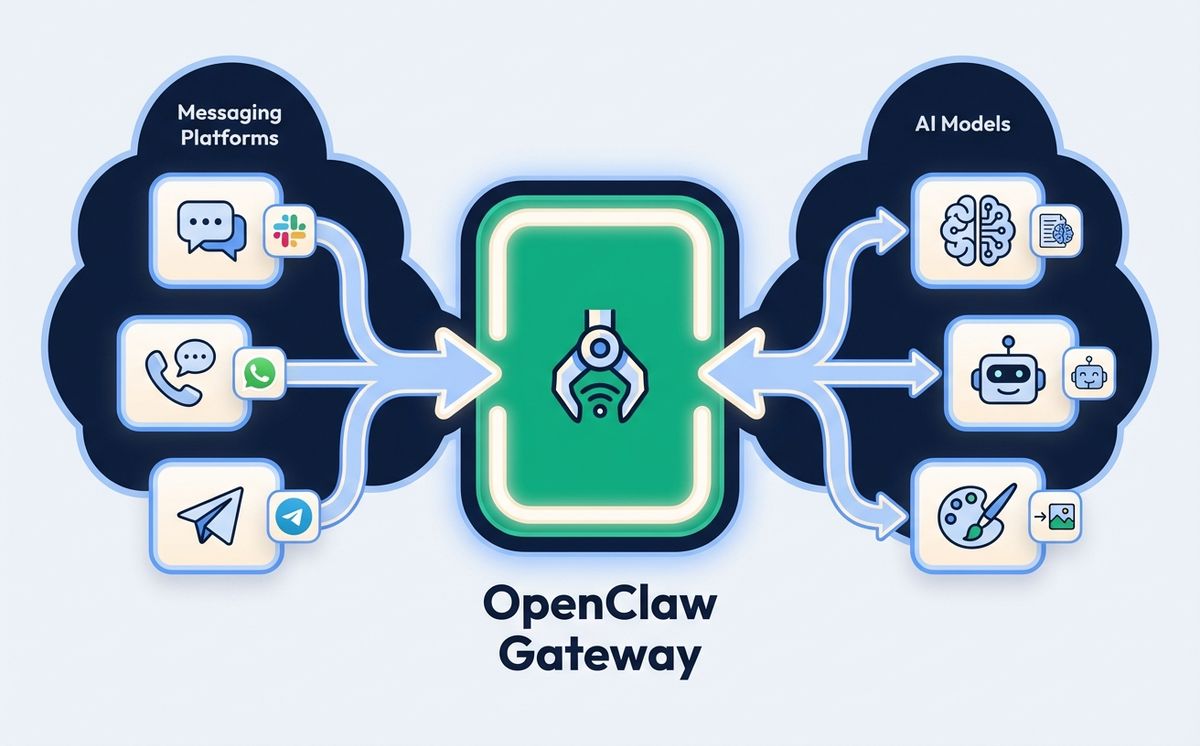

Ahora que hemos cubierto qué es OpenClaw, exploremos cómo funciona. En el núcleo de OpenClaw está el Gateway, un servidor WebSocket de larga duración que actúa como plano de control central. Toda interacción fluye a través de este Gateway. Cuando envías un mensaje desde Telegram, el Gateway lo recibe, lo enruta a la sesión apropiada, carga contexto y habilidades, envía la conversación al modelo de lenguaje que hayas configurado, ejecuta las herramientas que el modelo solicita, transmite la respuesta de vuelta a tu app de mensajería y escribe la conversación en memoria persistente.

Por defecto, el Gateway se vincula a localhost en el puerto 18789, lo que significa que solo los procesos en la misma máquina pueden conectarse. Esta es una decisión de seguridad deliberada. Si necesitas acceso remoto, el enfoque recomendado es usar una solución VPN como Tailscale en lugar de exponer el puerto al internet público.

La arquitectura sigue un patrón hub-and-spoke. El Gateway se ubica en el centro, con conexiones radiando hacia canales de mensajería (Telegram, WhatsApp, Discord, Slack, Signal, iMessage), interfaces de control (CLI, web UI, app macOS) y el runtime de IA. Cada canal es una integración incorporada, no un plugin. Configuras los canales en ~/.openclaw/config.json5.

Parte de entender qué es OpenClaw significa comprender el aislamiento de sesiones. Una conversación en un DM de Telegram es completamente separada de una en Slack, que a su vez es separada de un hilo en Discord. Este aislamiento significa que puedes usar OpenClaw para tareas personales en un canal y tareas de equipo en otro sin que el contexto se mezcle.

Si tienes curiosidad sobre cómo las arquitecturas modernas de IA permiten este tipo de comportamiento autónomo, la clave es que OpenClaw trata al modelo de lenguaje como un motor de razonamiento, no como un compañero de conversación.

Los Mejores Modelos Para Ejecutar OpenClaw

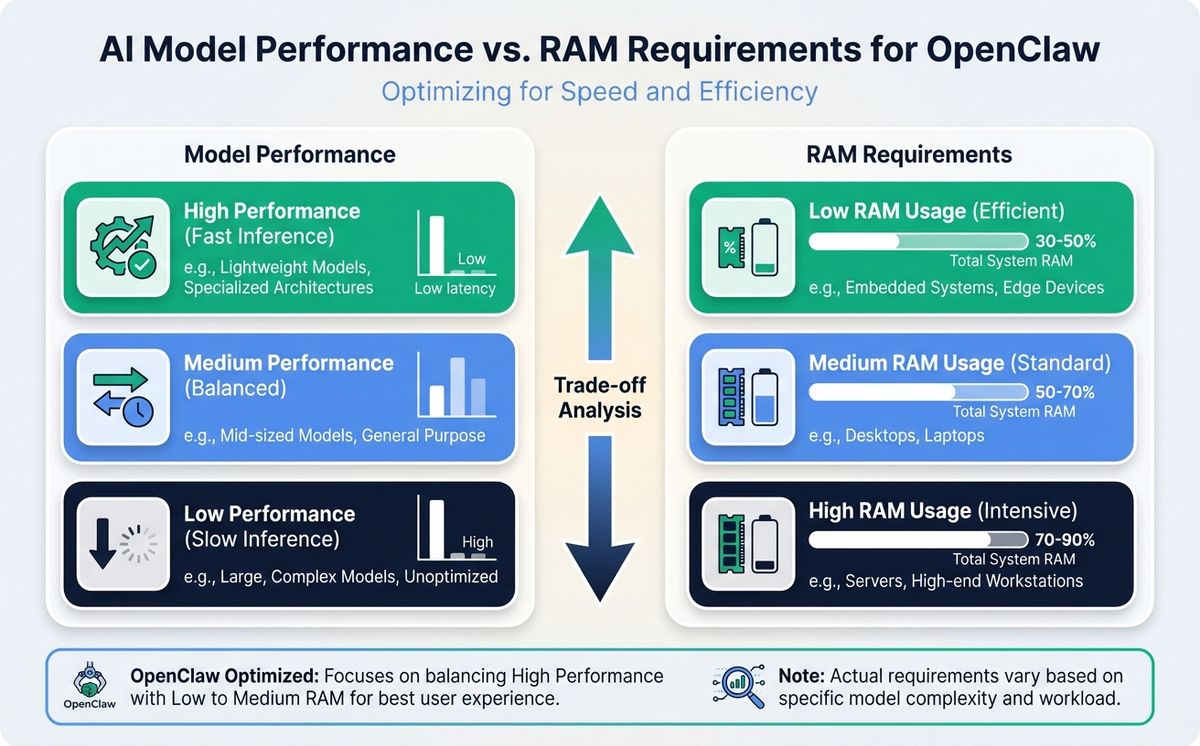

Una de las preguntas más frecuentes después de qué es OpenClaw es qué modelo usar. La respuesta depende de tu hardware y tu caso de uso. Elegir el modelo correcto es esencial para obtener el mejor rendimiento de OpenClaw.

8 GB de RAM: Qwen 3.5 9B. Si ejecutas OpenClaw en una máquina con 8 GB de memoria, el modelo Qwen 3.5 9B cuantizado a Q4KM (aproximadamente 6.6 GB) es tu mejor opción. Maneja llamadas a herramientas de forma confiable, soporta una ventana de contexto generosa y deja suficiente espacio para el Gateway. Instálalo con ollama pull qwen3.5:9b. Para usuarios que recién aprenden qué es OpenClaw, esta es la forma más fácil de empezar localmente.

16 GB de RAM: Qwen 3 14B. Con 16 GB puedes subir a la clase de 14B parámetros. Qwen 3 14B y DeepSeek-R1-Distill-Qwen-14B son los mejores en este rango. Ofrecen un razonamiento notablemente mejor y llamadas a herramientas más precisas comparado con el tier de 9B. Para la mayoría de tareas de asistente personal como resumir documentos y responder preguntas de investigación, 14B es el punto ideal.

24 GB+ de RAM: Qwen 3.5 27B o Qwen3-Coder 32B. Si tienes 24 GB o más de memoria unificada, algo común en máquinas Apple Silicon, los modelos de 27B y 32B se vuelven accesibles. Qwen 3.5 27B en cuantización Q4KM usa alrededor de 17 GB e iguala a GPT-5 mini en el benchmark SWE-bench con una puntuación de 72.4. Su ventana de contexto nativa de 262K maneja conversaciones largas sin truncamiento. Para tareas de código, Qwen3-Coder 32B obtiene aproximadamente 92.7 por ciento en HumanEval.

Modelos en la nube. Si prefieres no ejecutar modelos localmente, OpenClaw funciona perfectamente con Claude, GPT y Gemini a través de sus respectivas APIs. Los modelos en la nube ofrecen el mejor rendimiento puro a cambio de latencia y costo por token. Muchos usuarios que ya entienden qué es OpenClaw ejecutan un modelo local para tareas rutinarias y cambian a la nube para trabajos exigentes.

La integración con Ollama hace que cambiar modelos sea trivial. Entender qué es OpenClaw a nivel de modelo te ayuda a tomar decisiones informadas sobre costo, velocidad y privacidad.

Configuración de OpenClaw con Telegram

Telegram es el canal de mensajería más popular entre los usuarios de OpenClaw, y con buena razón. Funciona en todas las plataformas, soporta medios ricos, y la API de bots es madura. OpenClaw usa la librería de bots grammY bajo el capó, con middleware personalizado para control de acceso, deduplicación de mensajes y entrega por streaming.

Así es cómo empezar con OpenClaw en Telegram. Primero, abre Telegram e inicia un chat con @BotFather. Ejecuta el comando /newbot, sigue las instrucciones para nombrar tu bot y guarda el token. Luego, agrega el token a tu configuración de OpenClaw:

{

"channels": {

"telegram": {

"enabled": true,

"botToken": "TU_TOKEN_DEL_BOT",

"dmPolicy": "pairing"

}

}

}Inicia el Gateway de OpenClaw con openclaw start. Busca tu bot en Telegram y envíale un mensaje. Si usas la política de emparejamiento por defecto, ejecuta openclaw pairing approve telegram <codigo> en tu terminal para completar el handshake.

Una vez conectado, puedes chatear con tu agente OpenClaw desde cualquier lugar, incluyendo tu teléfono. Telegram soporta tanto DMs como grupos. Las sesiones de grupo están aisladas por ID de grupo. Esto es lo que hace a OpenClaw particularmente potente como asistente de IA móvil.

Long polling es el modo de conexión por defecto, lo que significa que no necesitas configurar webhooks ni exponer puertos. Perfecto para un servidor casero. Para menor latencia en despliegues de grupo, puedes cambiar a modo webhook, pero para uso personal, polling es más simple.

La belleza de esta integración es que convierte a OpenClaw en un asistente de IA móvil sin construir una app. Obtienes notificaciones push, compartir medios e historial de conversaciones. Si tu negocio necesita herramientas de comunicación impulsadas por IA, este patrón es notablemente efectivo.

Por Qué el Mac Mini M4 es el Hardware Ideal Para OpenClaw

Las personas que acaban de aprender qué es OpenClaw inmediatamente preguntan en qué hardware ejecutarlo. Ejecutar OpenClaw requiere una máquina siempre encendida, silenciosa, eficiente energéticamente y lo suficientemente potente para manejar modelos de IA locales. El Mac Mini M4 cumple todos los requisitos.

Apple Silicon usa una arquitectura de memoria unificada donde CPU y GPU comparten el mismo pool de RAM. Esta es una ventaja masiva al ejecutar modelos locales a través de Ollama, porque la GPU puede acceder a la asignación completa de memoria sin cuellos de botella. Un Mac Mini M4 con 24 GB de memoria unificada puede ejecutar cómodamente un modelo de 27B parámetros mientras maneja el Gateway de OpenClaw, Telegram y cualquier tarea en segundo plano.

El consumo de energía es notablemente bajo. En reposo, el Mac Mini M4 consume solo 3 a 4 vatios, comparable a un Raspberry Pi pero órdenes de magnitud más capaz. Bajo carga completa de inferencia, alcanza picos de alrededor de 15 vatios. En un año de operación 24/7, tu costo de electricidad es negligible.

Aquí tienes una guía práctica de hardware para ejecutar OpenClaw:

- Mac Mini M4, 16 GB ($599): Perfecto si planeas usar modelos en la nube exclusivamente con OpenClaw. Maneja el Gateway y todos los canales sin problemas.

- Mac Mini M4, 24 GB ($799-999): La elección recomendada para ejecutar modelos locales en OpenClaw. Soporta Qwen 3.5 27B y modelos similares de 27B a 32B con espacio de sobra.

- Mac Mini M4 Pro, 48 GB ($1,399+): Excesivo para la mayoría, pero si quieres ejecutar múltiples modelos grandes simultáneamente o alojar OpenClaw para un equipo pequeño, esta es la máquina.

La configuración es directa. Configura el Mac Mini para operación headless vía SSH, instala OpenClaw con npm i -g openclaw, crea un Launch Daemon para inicio automático y tienes un servidor de IA silencioso que cabe en tu palma. Para acceso remoto, Tailscale proporciona una VPN de configuración cero perfecta para este setup.

Si estás explorando la intersección entre IA y optimización de hardware, el Mac Mini M4 representa un punto de inflexión donde la IA local se vuelve práctica para uso diario.

Primeros Pasos con OpenClaw en Cinco Minutos

Ahora que sabes qué es OpenClaw y en qué hardware ejecutarlo, aquí está el camino más rápido de cero a un agente de IA personal funcionando.

Paso 1: Instala el runtime. OpenClaw requiere Node.js 20 o posterior. Instálalo globalmente con npm i -g openclaw. Si planeas ejecutar modelos locales, instala también Ollama y descarga tu modelo preferido.

Paso 2: Inicializa tu workspace. Ejecuta openclaw init en tu terminal. Esto crea el directorio de configuración en ~/.openclaw/ con un archivo config.json5 por defecto y un workspace para memoria persistente.

Paso 3: Configura tu modelo. Abre ~/.openclaw/config.json5 y establece tu modelo preferido. Para un modelo en la nube, agrega tu API key. Para un modelo local, apunta OpenClaw a tu instancia de Ollama en localhost:11434.

Paso 4: Conecta un canal de mensajería. Sigue la configuración de Telegram descrita anteriormente, o conecta WhatsApp, Discord, Slack o cualquier otro canal soportado. También puedes usar el chat integrado con openclaw chat.

Paso 5: Inicia el Gateway. Ejecuta openclaw start y envía tu primer mensaje. OpenClaw lo enrutará a través del Gateway, lo pasará a tu modelo configurado, ejecutará las herramientas solicitadas y transmitirá la respuesta de vuelta a tu canal.

Todo el proceso toma unos diez minutos. Si encuentras problemas, la documentación oficial es completa, y el Discord de la comunidad tiene más de 30,000 miembros activos. Cualquiera que pregunte qué es OpenClaw encontrará una comunidad excepcionalmente acogedora. Asegúrate de estar ejecutando la versión 2026.1.29 o posterior, que incluye un parche crítico para CVE-2026-25253.

Para organizaciones que entienden qué es OpenClaw y buscan servicios profesionales de despliegue de IA, la plataforma proporciona una base sólida que se puede personalizar y escalar.

Seguridad y Privacidad de OpenClaw

Ejecutar tu propio agente de IA viene con ventajas y responsabilidades. OpenClaw está diseñado con seguridad primero, pero necesitas entender los límites. Saber qué es OpenClaw también significa saber qué hace OpenClaw con tus datos.

El Gateway se vincula a localhost por defecto, bloqueando conexiones externas a menos que las abras explícitamente. El proyecto recomienda Tailscale o WireGuard para acceso remoto en lugar de reenvío de puertos. La integración con Telegram usa grammY con un sistema de emparejamiento que requiere aprobación manual para cada nuevo usuario. La autenticación de remitentes en grupos no hereda las aprobaciones de DM.

En enero de 2026, el proyecto divulgó CVE-2026-25253, una vulnerabilidad de ejecución remota de código con puntuación CVSS de 8.8. El equipo la parcheó en 48 horas y lanzó la versión 2026.1.29. Siempre mantén tu instalación de OpenClaw actualizada.

Tus datos permanecen en tu máquina cuando usas modelos locales. Las conversaciones, memoria y archivos del workspace se almacenan en ~/.openclaw/ y nunca se transmiten externamente. Cuando usas modelos en la nube, tus prompts se envían al proveedor del modelo, pero OpenClaw en sí no recopila ninguna telemetría. Esto es una parte crítica de entender qué es OpenClaw: privacidad por diseño.

Para las garantías de privacidad más fuertes, ejecutar un modelo local en un Mac Mini detrás de Tailscale te da un asistente de IA completamente aislado del internet público. Ningún dato sale de tu red. Ese nivel de privacidad, imposible con cualquier servicio de IA en la nube, es parte esencial de qué es OpenClaw.

Si tu organización tiene requisitos específicos de privacidad, entender la arquitectura de seguridad de herramientas como OpenClaw es esencial para tomar decisiones tecnológicas informadas.

El Futuro de OpenClaw y los Agentes de IA Personales

¿En qué se va a convertir OpenClaw? Es más que un producto. Es una señal de hacia dónde se dirige la computación personal. La idea de que cada persona tendrá su propio agente de IA, ejecutándose en su propio hardware, conectado a sus propias herramientas y datos, está pasando de ciencia ficción a realidad práctica.

Los números hablan por sí solos. Más de 300,000 estrellas en GitHub en dos meses. Un ecosistema de habilidades e integraciones construidas por la comunidad que crece diariamente. Una organización de respaldo que transiciona a una fundación independiente. Hardware que cuesta menos de mil dólares y ejecuta estos modelos eficientemente las 24 horas.

Ya sea que empieces con un modelo en la nube y un bot de Telegram o vayas con todo con un Mac Mini M4 ejecutando Qwen 3.5 localmente, la barrera de entrada nunca ha sido más baja. OpenClaw te da un agente de IA privado, extensible y agnóstico de modelo que realmente te pertenece.

La pregunta ya no es qué es OpenClaw. La pregunta es qué vas a construir con él. Comienza con la documentación oficial de OpenClaw, únete a la comunidad y da el primer paso para ser dueño de tu futuro con IA. Si necesitas ayuda integrando agentes de IA en los flujos de trabajo de tu negocio, contacta con nuestro equipo para explorar lo que es posible.

Artículos Relacionados

¿Qué pasaría si su próximo proyecto de software pudiera pensar, planificar y adaptarse de forma autónoma? El auge de los agentes de IA autónomos representa uno

Leer más

Explicamos cómo funciona un LLM con una metáfora sencilla: libros, tokens, mapas de conexiones y millones de correcciones. Sin jerga, con ejemplos reales.

Leer másListo para empezar tu proyecto?

Hablemos de cómo podemos ayudar a tu marca a crecer con una estrategia digital personalizada.

Contáctanos